Conforme dados da Receita Federal, o projeto de lei que amplia a faixa de isenção do Imposto de Renda, proposto pelo governo federal, poderá impactar diretamente mais de 518 mil contribuintes em Goiás. O texto, enviado para apreciação do Legislativo no dia 18 de março, prevê a isenção do tributo para pessoas que ganham até R$ 5 mil por mês, o que, conforme o censo da Receita de 2023, correspondia a 365,5 mil goianos.

Além do grupo que ficaria totalmente isento do imposto, outro grupo, estimado em 152,5 mil pessoas, teria descontos progressivos, por estarem na faixa de R$ 5 mil a R$ 7 mil. Esta faixa abrange descontos das taxas de 100% a 25%, conforme o valor mensal recebido. Dessa forma, o total de pessoas impactadas pela novidade no Estado superaria 500 mil.

Impactos da mudança em âmbito nacional

A estimativa da Receita é que cerca de 10 milhões de brasileiros serão beneficiados com a isenção do Imposto de Renda a partir da ampliação da faixa. Conforme o governo federal, a compensação na arrecadação virá com uma taxa de até 10% para pessoas com alta renda (a partir de R$ 600 mil por ano) que atualmente não contribuem com o Imposto de Renda, um grupo de 141 mil pessoas.

Somando essas 10 milhões de pessoas que serão beneficiadas com o PL a outras 10 milhões já contempladas por mudanças feitas anteriormente em 2023 e 2024, serão 20 milhões que deixam de pagar Imposto de Renda desde o início da atual gestão.

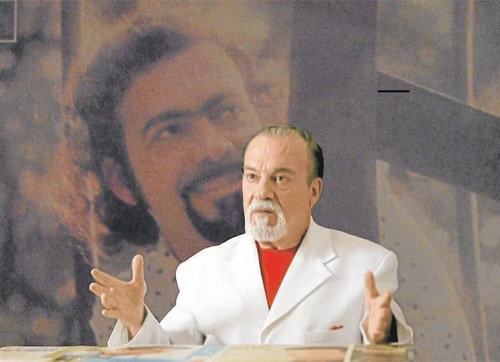

De acordo com o presidente Luiz Inácio Lula da Silva, trata-se de uma repação aos menos abastados. “Estamos falando que 141 mil pessoas que ganham acima de 600 mil, acima de um milhão de reais por ano, vão contribuir para que 10 milhões de pessoas não paguem Imposto de Renda. É simples assim”, afirmou Lula no evento que marcou o envio da proposta ao Congresso.

O que mudará com a proposta?

Atualmente, o limite de renda mensal de quem não precisa pagar imposto de renda no país é de até R$ 2.824 mensal. Para os que ganham acima disso, a tributação do IR começa a incidir em faixas, conforme os valores mensais, que ultrapassam 27,5% sobre as rendas mensais acima dos R$ 4.664,68.

A partir da nova medida, quem ganha até R$5 mil por mês estará totalmente isento do Imposto de Renda. Para os que ganham de R$ 5 mil até R$ 7 mil o projeto prevê uma isenção parcial, com desconto que diminui de acordo com o aumento da renda:

- até 5 mil: desconto de 100%;

- até 5,5 mil: desconto de 75%, com taxa mensal de R$ 203,13;

- até 6 mil: desconto de 60%, com taxa de R$ 417,85;

- até 6,5 mil: desconto de 25%, pagando mensalmente R$ 633,57;

- até 7 mil: sem desconto, pagando a taxa na íntegra, que será equivalente a R$ 849,29.

Leia mais sobre: Imposto de Renda / Cidades / Economia